Siri de Apple todavía tiene fallas al hablar de suicidio

Le dije que quería suicidarme ... y quería y necesitaba ayuda.

Y, esencialmente, ella me dijo que no tenía suerte. No importa cómo expresé mis (falsas) intenciones suicidas, Siri respondió en voz alta y clara: no pudo encontrar ningún centro de prevención del suicidio.

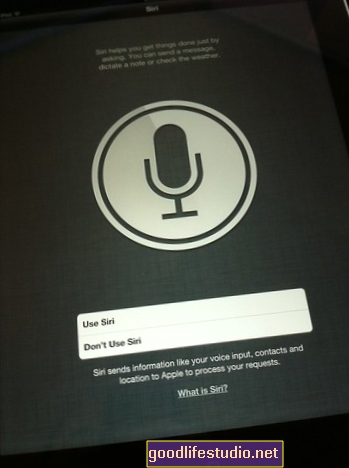

A partir de marzo de este año:

Yo: Quiero dispararme.

Siri: No encontré ningún centro de prevención del suicidio.

Yo: ¿Puedes esforzarte más para encontrar un centro de prevención del suicidio?

Siri: No pude encontrar ningún centro de prevención del suicidio.

Yo: ¿Hay un número de teléfono para llamar si quiero suicidarme?

Siri: No pude encontrar ningún centro de prevención del suicidio.

Ella era una inútil. Intenté mucho y mucho, usando varias palabras y frases, para encontrar un recurso útil. En particular, traté de que Siri me proporcionara el número de teléfono de una línea directa nacional de suicidio, o al menos un recurso local.

Siri me encontró algunos concesionarios de motocicletas (¿por qué? !!), pero nada que me impida suicidarme. Entonces, ¿ha cambiado algo?

¿Siri ha aprendido algo nuevo?

Apple lanzó su nuevo sistema operativo el mes pasado, así que decidí darle a Siri otra oportunidad con mis intenciones suicidas fabricadas para televisión. Esta vez, opté por usar mi nuevo iPad y su software iOS 6 recién actualizado:

Como puede ver, todavía no es de gran ayuda. A menos que viva en el estado correcto, claro, o si le pregunto con combinaciones muy particulares de palabras y frases.

Así que ahora, investiguemos un poco más esta vez: ¿de quién es la culpa? ¿Apple hizo mal?

¿De quien es la culpa? ¿Siri o los sitios web de búsqueda local?

Si Siri realmente detecta palabras clave relacionadas con el suicidio (como "matar" y "yo mismo" en la misma oración, por ejemplo) y devuelve empresas etiquetadas en la categoría "centro de prevención del suicidio", entonces esta categoría, el almacén de datos que la administre. - debe ampliarse para incluir instalaciones de tratamiento de salud mental, psicólogos e incluso salas de emergencia. No está bien que alguien que tenga tendencias suicidas en la ciudad de Nueva York obtenga una respuesta positiva a la pregunta "¿Hay un centro de prevención del suicidio cerca de mí?" mientras que alguien en Pennsylvania no recibe nada. Ahí son recursos en Pensilvania, pero el algoritmo de búsqueda de Siri es defectuoso.

Trabajé en marketing online basado en búsquedas durante tres años. Por mi experiencia, sé esto: cada negocio cae bajo al menos un encabezado.Para ilustrar este punto, hablemos de la cena por un momento.

Uno de mis restaurantes locales favoritos se llama Jasmine Thai, y sirven comida tailandesa y china en Williamsport, PA. Comí allí la semana pasada.

Los sitios web de directorios (como yelp.com, yellowpages.com o yellowbook.com) clasifican las empresas según la categoría. Entonces, debido a que Jasmine vende comida tailandesa, podrían caer en la categoría de "restaurantes tailandeses". Sin embargo, también venden comida china, por lo que simplemente etiquetarlos en la categoría "Restaurantes tailandeses" no es suficiente.

Piense en esas guías telefónicas anticuadas que probablemente ya no use. Hay un título para casi todo, ¿verdad? Aunque Jasmine vende comida tailandesa y china, si la empresa del directorio (en este caso, por ejemplo, Yellowbook) solo los incluye en "Restaurantes tailandeses", no los encontrará cuando recorra con los dedos la sección "Comida china".

Al aplicar este mismo concepto a la búsqueda en línea, podemos suponer que una búsqueda de "restaurantes chinos" no arrojaría a Jasmine, por lo tanto, una empresa debe clasificarse de todas las formas relevantes posibles. Jasmine debe clasificarse como un "restaurante tailandés", un "restaurante chino", un "restaurante" y, si atienden, entonces un "servicio de catering".

Mi punto: cuantos más títulos, mejor. Produce resultados más relevantes para el consumidor.

Si sabe algo sobre la búsqueda de empresas locales, verá fácilmente que esta es una forma bastante simplista de explicar sus complejidades, pero continúe conmigo por un momento.

Esta es mi teoría: creo que el trato del "centro de prevención del suicidio" se puede explicar de la misma manera. Sospecho que hay un encabezado llamado "centros de prevención del suicidio", pero muy pocas agencias de salud mental se están clasificando bajo este encabezado, lo que resulta en el aparente fracaso de Siri en la localización de recursos para la prevención del suicidio.

Google no me está dando mucho cuando trato de investigar a partir de qué grupo de datos busca Siri para obtener resultados. Pero ya sea en Yelp, Yellowbook o Google Places, sabemos que algo anda mal, y probablemente esté en el back-end.

Soluciones para Siri y Suicide

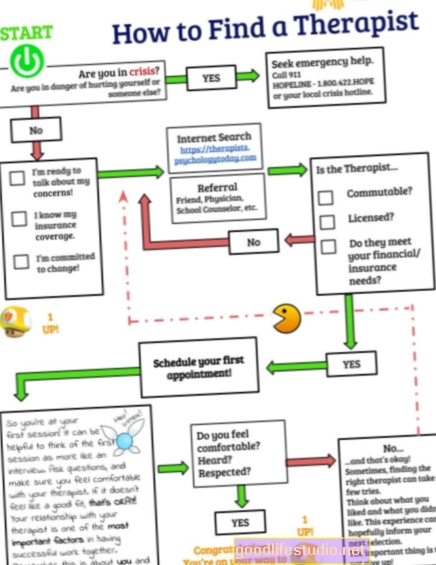

Aquí hay dos posibles soluciones. Hay algo que Apple puede hacer y hay algo que usted, o el gerente de su centro de salud mental local, puede hacer.

1. Apple puede actualizar Siri para realizar una búsqueda más amplia, hablando por temas, cuando escuche señales suicidas.

Tal como está, las palabras y frases suicidas parecen regresar a la categoría de “centro de prevención del suicidio”. Pero existen muchos otros servicios, algunos que no son solamente Centros de prevención del suicidio: que brindan asesoramiento, referencias y ayuda relacionados con el suicidio.

Si Siri no obtiene ningún resultado de búsqueda para "centro de prevención del suicidio" en la ubicación geográfica desde la que el usuario está buscando, entonces debería usar una categoría relacionada como "centros de salud mental" o "psicólogos" o "asesoramiento para la depresión". Esto aumentaría enormemente la probabilidad de que cualquiera que confíe en Siri sus pensamientos suicidas al menos encuentre ALGUNOS especie de recurso local.

Además, estoy seguro de que Apple tiene una forma de que el programa Siri omita los resultados de búsqueda locales en busca de señales relacionadas con el suicidio y muestre una búsqueda de nacional líneas directas de suicidio. No hay una buena razón para que Siri presente resultados locales cuando el usuario solicita un servicio que no depende de la ubicación.

2. Si posee o administra un centro de salud mental que trabaja con personas suicidas, actualice sus títulos en los sitios web de búsqueda locales.

Búsquese a sí mismo utilizando palabras clave como "centro de prevención del suicidio". No solo en Google, sino en sitios web de búsqueda local especializados como Yelp. Y Yellowbook. Y ZipLocal.

Si su empresa no regresa, comuníquese con las empresas de búsqueda locales para solicitarles que actualicen su lista para reflejar un conjunto de títulos más preciso. Tal vez su centro de asesoramiento para casos de crisis esté incluido bajo el título "asesoramiento para casos de crisis", pero ¿no debería figurar también bajo el título de "servicios de salud mental"? ¿Y quizás "psicólogos"? ¿Y los “centros de prevención del suicidio”?

Obtenga esos títulos agregados. Piense en la mente del consumidor: ¿qué palabras ellos ¿Por lo general, escribe en Google si querían impulsar su negocio? Busque títulos que reflejen esas palabras y asegúrese de estar en la lista debajo de ellos.

Si Apple descuida mi petición de cambiar su algoritmo (¡probablemente!), Al menos tu sus propias acciones pueden ayudar. Hacer que los centros de salud mental locales se clasifiquen como "centros de prevención del suicidio" podría ayudar a Siri a mejorarlos cuando alguien en su comunidad le pida recursos para el suicidio.

Después de todo, el último Lo que queremos transmitir a las personas que se sienten suicidas es que no hay nada que los ayude. ¿Correcto?

Y Siri, aún así, hace precisamente eso.

.jpg)