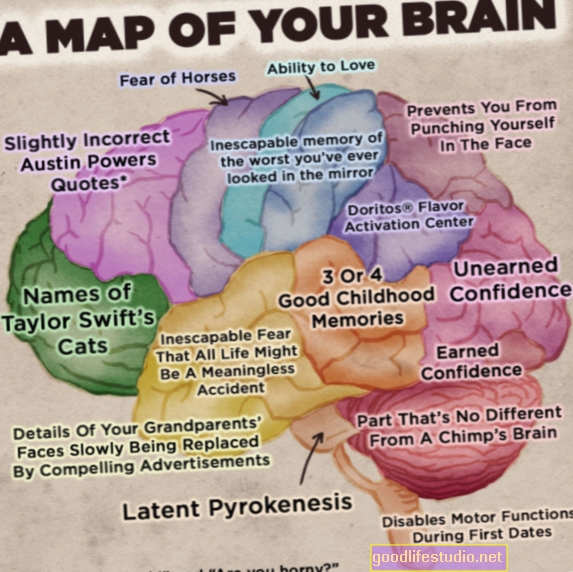

Detalles del mapa Cómo organiza el cerebro los datos visuales

El mapa, logrado a través de modelos computacionales de datos de imágenes cerebrales recopilados mientras los voluntarios veían horas de clips de películas, es lo que los investigadores llaman "un espacio semántico continuo".

Algunas relaciones entre categorías tienen sentido, ya que los humanos y los animales comparten el mismo "vecindario semántico", mientras que otras son menos obvias, como pasillos y cubos, señalan los investigadores.

“Nuestros métodos abren una puerta que rápidamente conducirá a una comprensión más completa y detallada de cómo está organizado el cerebro. Nuestro visor de cerebros en línea ya parece proporcionar la visión más detallada de la función visual y la organización de un solo cerebro humano ”, dijo Alexander Huth, estudiante de doctorado en neurociencia en UC Berkeley y autor principal del estudio publicado en la revista. Neurona.

Una comprensión más clara de cómo el cerebro organiza la información visual puede ayudar con el diagnóstico médico y el tratamiento de los trastornos cerebrales, según el investigador.

Estos hallazgos también pueden usarse para crear interfaces cerebro-máquina, particularmente para sistemas de reconocimiento de imágenes faciales y otros, agregó. Entre otras cosas, podrían mejorar la capacidad del sistema de autopago de una tienda de comestibles para reconocer diferentes tipos de mercancías.

"Nuestro descubrimiento sugiere que los escáneres cerebrales pronto podrían usarse para etiquetar una imagen que alguien está viendo y también pueden ayudar a enseñar a las computadoras cómo reconocer mejor las imágenes", dijo Huth, quien ha producido un video y un sitio web interactivo para explicar la ciencia de qué los investigadores encontraron.

Durante mucho tiempo se pensó que cada categoría de objeto o acción que ven los humanos (personas, animales, vehículos, electrodomésticos y movimientos) está representada en una región separada de la corteza visual, anotó Huth. En este último estudio, los investigadores de UC Berkeley encontraron que estas categorías en realidad están representadas en mapas superpuestos altamente organizados que cubren hasta un 20 por ciento del cerebro, incluidas las cortezas somatosensorial y frontal.

Los científicos registraron la actividad cerebral de cinco investigadores a través de imágenes de resonancia magnética funcional (fMRI) mientras cada uno veía dos horas de clips de películas. Los escáneres cerebrales midieron el flujo sanguíneo en miles de lugares del cerebro.

Luego, los investigadores utilizaron un análisis de regresión lineal regularizado, que encuentra correlaciones en los datos, para construir un modelo que muestra cómo cada una de las aproximadamente 30,000 ubicaciones en la corteza respondía a cada una de las 1,700 categorías de objetos y acciones que se ven en los clips de película. A continuación, utilizaron el análisis de componentes principales, un método estadístico que puede resumir grandes conjuntos de datos, para encontrar el "espacio semántico" que era común a todos los sujetos del estudio.

Los resultados se presentan en mapas multidimensionales multicolores que muestran las más de 1.700 categorías visuales y sus relaciones entre sí. Las categorías que activan las mismas áreas del cerebro tienen colores similares, señalaron los investigadores. Por ejemplo, los humanos son verdes, los animales son amarillos, los vehículos son rosas y violetas y los edificios son azules.

“Usando el espacio semántico como una herramienta de visualización, vimos inmediatamente que las categorías están representadas en estos mapas increíblemente intrincados que cubren mucho más del cerebro de lo que esperábamos”, dijo Huth.

Fuente: Universidad de California, Berkeley